Depuis quelque temp, un mouvement de fond s’observe : un retour progressif vers les infrastructures locales. La raison ? Même s’il a de nombreux atouts, le Cloud ne coche plus toutes les cases dès que l’on parle de confidentialité des données, de latence ou simplement de coûts. C’est sur ce créneau que QNAP positionne son QAI-h1290FX. Un serveur de stockage pensé pour les charges de travail IA : LLM, architectures RAG, inférence en temps réel. Ici, il ne s’agit pas d’un simple NAS avec un logo IA collé dessus…

QNAP QAI-h1290FX

Le QAI-h1290FX est un boitier 12 baies SSD U.2 NVMe/SATA. Pas de disques rotatifs ici, on est clairement dans le registre des IOPS élevées, indispensables pour alimenter des pipelines de données intensifs ou soutenir l’inférence en temps réel sans créer de goulot d’étranglement côté stockage. Il est animé par un AMD EPYC 7302P (16 cœurs / 32 threads) pouvant atteindre 3,3 GHz. A noter que ce processeur a obtenu 32 114 points selon PassMark. Ce dernier est épaulé par 128 Go de RAM RDIMM DDR4 ECC extensible jusqu’à 1 To (8 × 128 Go)

Le QAI-h1290FX n’est pas un NAS comme les autres. Il est compatible avec les cartes NVIDIA RTX, notamment la RTX PRO 6000 Blackwell Max-Q, embarquant jusqu’à 96 Go de VRAM. Une capacité mémoire GPU qui change la donne pour quiconque veut faire tourner des LLM de taille respectable en local. La prise en charge de CUDA, TensorRT et du Transformer Engine vient confirmer l’orientation IA-first de la machine. On n’est pas sur un gadget, mais un outil capable d’accélérer des modèles de deep learning, de génération d’images ou de traitement du langage naturel.

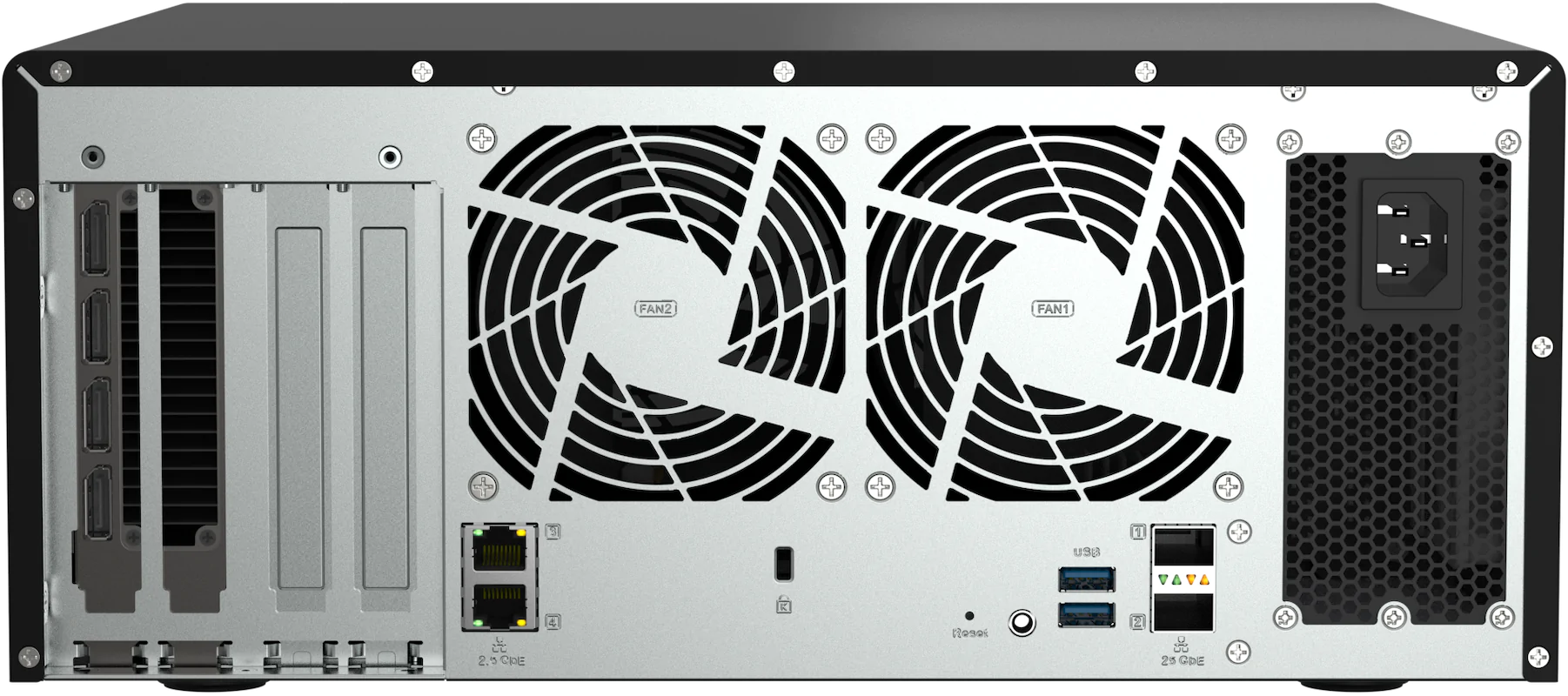

Connectique

La connectivité est à la hauteur des ambitions du boîtier :

- 3 ports USB 3.0

- 2 ports réseau 2,5 Gb/s

- 2 ports réseau 25 Gb/s en SFP28

A noter la présence de 4 emplacements PCIe (3* Gen 4 x16 et 1* Gen 4 x8)

QuTS hero et l’écosystème logiciel

Côté système, on est sur du QuTS hero, basé sur ZFS. On retrouve les fonctionnalités attendues pour un usage professionnel : déduplication, snapshots, intégrité des données. Rien de révolutionnaire pour les habitués de la gamme… Container Station et Virtualization Station permettent de gérer des environnements bénéficiant d’un accès direct au GPU, ce qui permet aux équipes de déployer des modèles sans friction et sans reconfiguration complexe.

Plusieurs outils populaires dans l’écosystème IA open source sont préinstallés :

- AnythingLLM, OpenWebUI, Ollama : pour monter rapidement un LLM privé ;

- vLLM* : moteur d’inférence LLM ;

- Stable Diffusion*, ComfyUI* : pour la génération d’images ;

- n8n* : pour l’automatisation et les workflows sans code.

C’est une approche « prêt à l’emploi » qui tranche avec les serveurs IA nus que l’on retrouve chez certains concurrents.

En synthèse

Le QNAP QAI-h1290FX est un serveur de stockage conçu de bout en bout pour répondre aux besoins d’IA on-premise. L’alliance d’un stockage full-flash NVMe, d’un processeur EPYC et d’une compatibilité GPU NVIDIA en fait une plateforme intéressante pour les entreprises qui souhaitent reprendre la main sur leur stratégie IA (sans dépendre du cloud ou exposer leurs données).

Les logiciels faciles à installer (Ollama, OpenWebUI, n8n…) abaissent la barrière à l’entrée, ce qui est un point fort pour les équipes IT non spécialisées. Reste à connaître son prix et la date de disponibilité…

* en cours d’intégration